【官方双语】卷积的两种可视化|概率论中的X+Y既美妙又复杂

小病就治-大病就:

小病就治-大病就:

本科上高阶概率论的时候,老师花了整整一节课50分钟的时间给我们讲了CLT的严格证明,从头到尾只讲这一个知识点,到下课刚好证完,没有丝毫拖堂。当时看着那一黑板的证明过程我真的惊为天人,无论是证明思路还是老师的节奏,那都是我在数学系里上过印象最深的一堂课。

【回复】我印象最深刻的是科大的数分教科书,全册书最后又回到了全书最开始的问题,仿佛整本书就是为了解决一个问题,但是把所有的都讲了。虽然现在都忘了,但是当时看的我想当震惊。

【回复】我的量子力学老师推导一维谐振子的定态薛定谔方程时,也是一整节课刚刚好推完,逻辑条理清晰,板书工整简洁,至今难忘

【回复】回复 @宇多田的熊 : 呜哇,怎么可能是程艺的那本数学分析讲义,那本书也就复习用用初学时候看到那玩意什么心情还不懂吗 嘀哩嘀哩滴哩哩啦啦:

嘀哩嘀哩滴哩哩啦啦:

我会学的,我醒了就学,我就睡一会☝️

【回复】醒不了了,埋了罢(悲)

【回复】醒了醒了,这就学。。。[捂脸],你们可真是

(骂骂咧咧翻开书)(丫的这都什么玩意)(嘶,今日的热门朕好像还没翻阅)(这一个个小封面都有点意思啊[歪嘴])

唉算了,一会学[害羞] 今日方洲:

今日方洲:

其实正态分布只是一大类满足stable law(就是自己卷积自己还是自己)的概率分布中的一个,算特征函数能知道这一类分布由一个参数决定。

正态分布之所以频频出现是因为只有它有方差(像柯西分布就没有方差,甚至没有均值)

【回复】6 正态分布之所以重要是因为大样本情形下所有分布的均值依概率收敛到正态分布

【回复】方差/标准差跟期望不收敛的分布还是少见的。。。正态分布常用只是因为确实很常见,各种无论是切比雪夫还是依概率收敛都是用的正态分布来搞的。

【回复】回复 @但愿长醉不复醒゛ :还是要求一阶矩和二阶矩有界的,物理系统里还是有不少不满足这个的 3Blue1Brown:

3Blue1Brown:

如果你想要帮助一下未来的项目的话:https://www.patreon.com/3blue1brown

另一种等价的同样有价值的支持形式是分享这期视频... 我今天不想吃晚饭:

我今天不想吃晚饭:

顺便说一句,小学学习的竖式乘法就是离散的卷积[嘘声]

【回复】原来小学二年级就学卷积是真的[惊讶]

【回复】很对,以及多项式、幂级数乘法 折原白明:

折原白明:

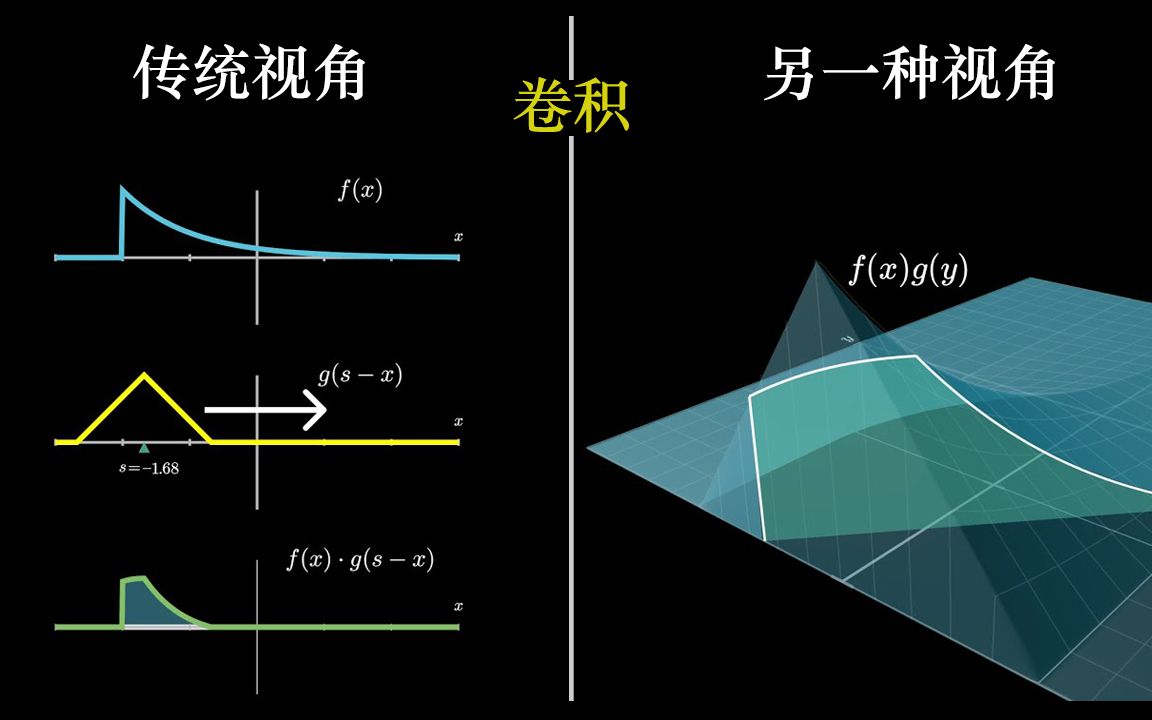

我很喜欢3b1b的这种视频。虽然人们已经熟知这些基础的知识,但我还是想知道为什么会有这些知识、如何在直观上理解他们,更重要的是,我也可以知道人们为什么选择这种计算来解决问题。也许这对大佬来说并没有什么作用,但这些视频对于一个尚未了解行业的本科学生真的受益匪浅。

“为什么输入信号经过系统的结果,需要利用卷积来计算?卷积计算和物理实现过程到底有什么关系?”如果没有这些“基础的定义性”视频,这个问题还会困扰我更久。而现在,这些视频的思路真的让我茅塞顿开。

爱来自瓷器

【回复】回复 @maencn : 我们都知道,对于一个零状态系统,其输出信号y(t)=h(t) * x(t),也就是输入信号和系统冲激响应的卷积。

实际上系统每个时刻的输出并不取决于当前时刻的输入。在t+dt时刻的输出,不仅要考虑当前t+dt时刻的输入,还要考虑t时刻输入信号在t+dt时于系统中残留的响应——更确切的说,我们要考虑自零时刻起到当前,所有输入信号在目前的响应,并把他们加起来。

离散信号好处理,毕竟只要考察的时间有限,要计算的时刻数也有限。在t=0时刻输入的单位冲激信号,到了t0时便衰减成了h(t0) ;同理在t=0时刻输入幅值为f(0)冲激信号,到了t0时便衰减成了f(0)·h(t0) 。在其他时刻输入的信号也是同样的道理。

连续信号与离散信号不同,它任意两个时刻之间都是稠密的,所以我们选择用冲激信号描述某个函数在某一时刻的幅复(可以参考冲激函数的广义函数定义),并最后利用积分,将以前所有时刻输入在当下的响应全部加起来。

【回复】回复 @maencn :简单清晰明了!

输入信号 与 冲击函数 的卷积函数,就是输入信号本身,

看起来就是输入信号被冲击函数拆分 转换了

之后............[微笑]

【回复】所以为什么输入信号经过系统的结果,需要利用卷积来计算? kepler-lau:

kepler-lau:

让我想起来我小时候看的“可汗学院”[打call]

【回复】Grant还真做过两年可汗学院的讲师[吃瓜]

【回复】回复 @第47号福瑞控 :多元微积分那个课好像是他

【回复】回复 @kepler-lau :好像是多元微积分[吃瓜] Eccedecemmilia:

Eccedecemmilia:

我觉得视频中对连续随机变量这件事的处理是有问题的,或者至少是不全面的。当然,我的专业并不学概率论这门课,所以问得可能比较幼稚,但还是希望有朋友能与我讨论一下。

在离散的随机变量情形,比如说有两个独立的随机变量X和Y,他们都从{0, 1, 2, 3}里头取值,并且定义S = X + Y,那么确实可以写出例如 P(S=2) = P(X=0)*P(Y=2) + P(X=1)*P(Y=1) + P(X=2)*P(Y=0) 这样卷积形式的等式。这里的关键在于S=2是一个随机事件,并且由于S依赖X和Y,所以可以拆成一些关于X和Y的随机事件。

连续随机变量则不同。为了防止混淆,明确一下写法,P(·)表示发生(·)这件事的概率,而p(X)表示连续随机变量X的pdf。假设有两个独立的随机变量X和Y,他们从区间【0, 3】里头取值。定义S = X + Y。现在p(S=2)并不是代表了S=2这个事件的概率,而是变量S的pdf在2这个地方的值。条件够好(假设pdf连续应该就好了?)的话,p(S=2) = P(2≤S≤2+dS) / dS。所以与p(S=2)相关的事件倒不如说是2≤S≤2+dS。S=2这个事件诚然可以拆成满足(X=t且Y=2-t)的所有事件的并,从而也可以形式地写 P(S=2) = 求和(P(X=t) * P(Y=2-t),其中t从0到2),可是在连续变量的情形下,这个式子没有多少意义。P是P,p是p,分拆了S=2这个事件并不代表就分拆了2≤S≤2+dS这个事件,从上面那个式子也不能理所当然马上得出 p(S=2) = 积分(p(X=t) * p(Y=2-t),其中t从0到2)。这中间的道理还需要补上。

【回复】25:10左右的截图。你说的是对的,要把“pdf(s)*ds”本身当成一个小概率,到头来是熟悉黎曼和-极限-积分这个过程,就能理解离散-极限-连续的底层逻辑

【回复】从离散到连续就是抽象出概率密度来摆脱“事件发生”这个离散东西。我觉得这时候的视角应该是“连续区间”,而不是“某个事件”本身,因为每个事件都被切分得无穷小了,所以再按照离散的情况来分析 P(S=2) 这个没什么意义,它就等于 0 (但是依然可能发生,这涉及测度论什么的)。视频里 11:00 后就说得挺好的,不理解的话可能需要补补过往的概率论视频,那里有更多讨论

【回复】续上一条。

我认为只能这么写:

p(S=2) dS = 积分(p(X=x) * p(Y=y)),积分域由 2 ≤ x+y ≤ 2+dS 定义。

这个积分域不再是视频中那样的y = 2 - x的直线,而是这条直线附近“宽”为dS的带状域。这个二重积分很好处理,右边容易得出是 dS * 积分(p(X=t) * p(Y=2-t),其中t从0到2),两边约掉dS,便得到所求关于pdf的卷积形式的等式。这边如此轻松干掉dS的原因是函数S = X + Y的形式极其简单。一般来说,积分域会是 S(X, Y) 的两条“相邻”的等高线所夹的狭长区域,如果函数取一些非线性的形式(例如评论区提到的S = X*Y),则会复杂一些。

总之,推导并没有很难,但视频直接从离散的P类比到连续的p的做法,我认为从概念上不太说得过去,需要这样补全。 大黄瓜一不小心:

大黄瓜一不小心:

本来想芦管的,看到这个视频必须自律!

【回复】为什么不能对着这个炉管!

【回复】回复 @辣个放荡不羁的男人 :6

【回复】你一天自律了好几次吧[嗑瓜子] 派蒙科普:

派蒙科普:

阿伟,你又在玩电动喔,休息一下吧,来看看3b1b的视频好不好。 当年线代:

当年线代:

在系统满足线性和时不变性,矩阵是一个循环矩阵,所以就有了卷积。 金城屠龙刀:

金城屠龙刀:

信号处理专业表示在大脑在懂与不懂的边缘上反复横跳并且大量产出废热[笑哭] 琴梨的水桶:

琴梨的水桶:

那两个随机变量相乘呢?(我知道有人会说化成对数相加,但随机变量不一定是恒正的)

【回复】直接用一般方法求吧,Fz = ∫∫_(z≥xy) f(x,y) dσ

【回复】或许负数情况可以分四类讨论一下

【回复】“对双曲线xy=s上方的截面来积分”会出现什么问题[吃瓜]思考题 Den白羊:

Den白羊:

很灵啊,一点开视频就瞌睡,眼皮就跟两块磁铁一样啪一下就合上了[tv_睡着]

【回复】这个形容很贴切啊[脱单doge] 考妍数学汤家夙:

考妍数学汤家夙:

总感觉这种东西是数学黄片,略过繁杂的准备,直接给你看最爽的部分[捂眼][捂眼]

【回复】什么比喻啊哈哈哈好有道理 质量管理计量:

质量管理计量:

感谢3blue1brown提供的教学资源,我非常希望能够加入这个团队,但我也清楚我现在的能力不够。数学不仅是计算,更是解释,是科学的语言