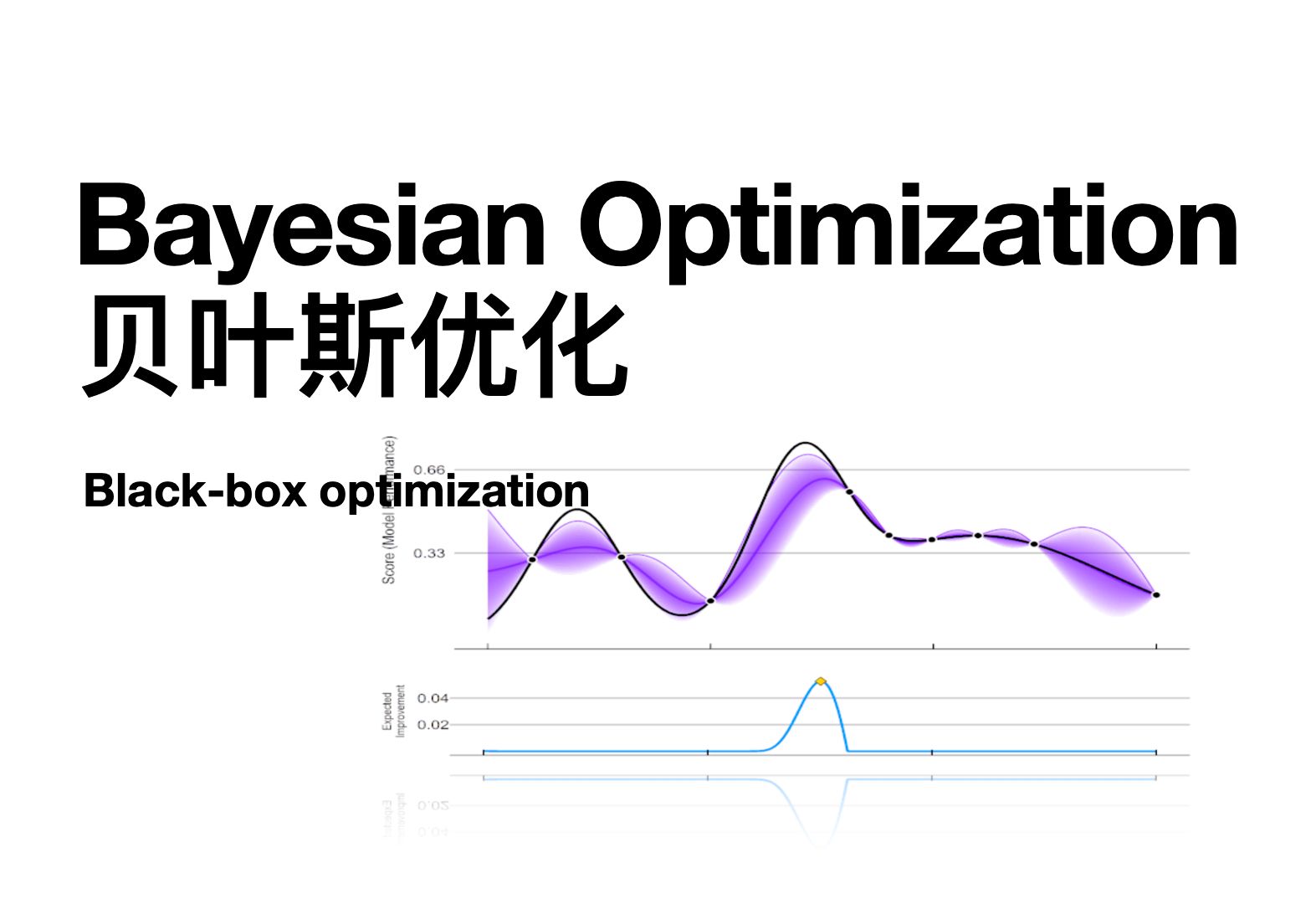

贝叶斯优化 | 黑盒优化+全局最优方法 | Bayesian Optimization

Keith1901:

Keith1901:

感谢up主, 听懂了一些, 似乎是用统计模型(多元正太分布)去近似目标函数, 所以首先把这个正态分布的参数给估计出来, 然后就可以根据统计模型去下一个观测点了.

第一种是基于期望最大化的方法.

第二种是希望均值尽可能地大.

但应该没有提到如何学到这个正太分布, 以及如何更新正太分布的参数. 最后的魔术师:

最后的魔术师:

贝叶斯这个神人再次证明,经验主义的伟大意义[打call] 进一寸有一寸的乐趣:

进一寸有一寸的乐趣:

想问一下博主,类似于EM算法或者贝叶斯优化这样的过程,我们是否可以嵌入到神经网络里面呢,而不是仅仅去优化神经网络的超参数。

举个例子kmeans这个方法可以用神经网络来代替学到应该聚类几个个数,是否我们可以用贝叶斯神经网络或者EM-NN什么样的方式让神经网络可以自己学到应该给几个聚类呢?

这样的话就可以大大加强神经网络的通用性了呢 听听你的呼吸:

听听你的呼吸:

最近正打算看下,请问可以用在遗传算法的评价函数中吗 许我一生无敌:

许我一生无敌:

我从工程角度唱点反调,贝叶斯优化的一个应用场景就是f耗时,但是其具体实现并不能保证就比计算f更省时,主要因为底层依赖GPR,而GPR的缺点就是需要求逆矩阵。

举个例子,算法3用10个初始值(对于有非常多个极大极小值的目标函数来说是否太稀疏了姑且不论),每个更新100次,每次更新需要算一次G,一次G要算1000次梯度,一共10^6次梯度计算,每次需要求一个n+1阶逆矩阵和解一个优化问题,n只要一大,求逆时间懂得都懂,所以贝叶斯优化省时对大n来说是不适用的[doge] 进一寸有一寸的乐趣:

进一寸有一寸的乐趣:

贝叶斯优化,MCMC,朗之万方程,感觉这些似乎不同,但又有相同之处哎。 JOHNDSTUDIO:

JOHNDSTUDIO:

小白第一次看这个,很受启发!想请问一下决策变量维数很高,远大于20,且目标函数耗时的情况,也可以用贝叶斯优化吗?或者有什么适合的方法吗?[保佑] 我原来才是りんりん吖:

我原来才是りんりん吖:

最近在看贝叶斯回归论文,但怎么推导条件概率求后验的步骤还是不太懂 感觉论文和book完全讲两个理论[笑哭] zhaiking233:

zhaiking233:

[酸了]好数学啊,证明过程看起来好费劲,只能下次一定了 控...:

控...:

赞[打call]请问up,这种用Bayesian的方法做零阶优化有对应的convergence之类的结果吗 zzydaochulang:

zzydaochulang:

感觉思路很像mcmc,但是用bayesian来做优化却是第一次接触,很有意思[打call] 哔哩哔哩神盾局:

哔哩哔哩神盾局:

博主,想问一下这个可以用来做炼油厂的生产优化问题吗 顶天立地穷光蛋:

顶天立地穷光蛋:

想请问一下up主有关于贝叶斯优化的文献吗 bili_火柴:

bili_火柴:

每次优化结果差别很大,怎么控制解决?老师