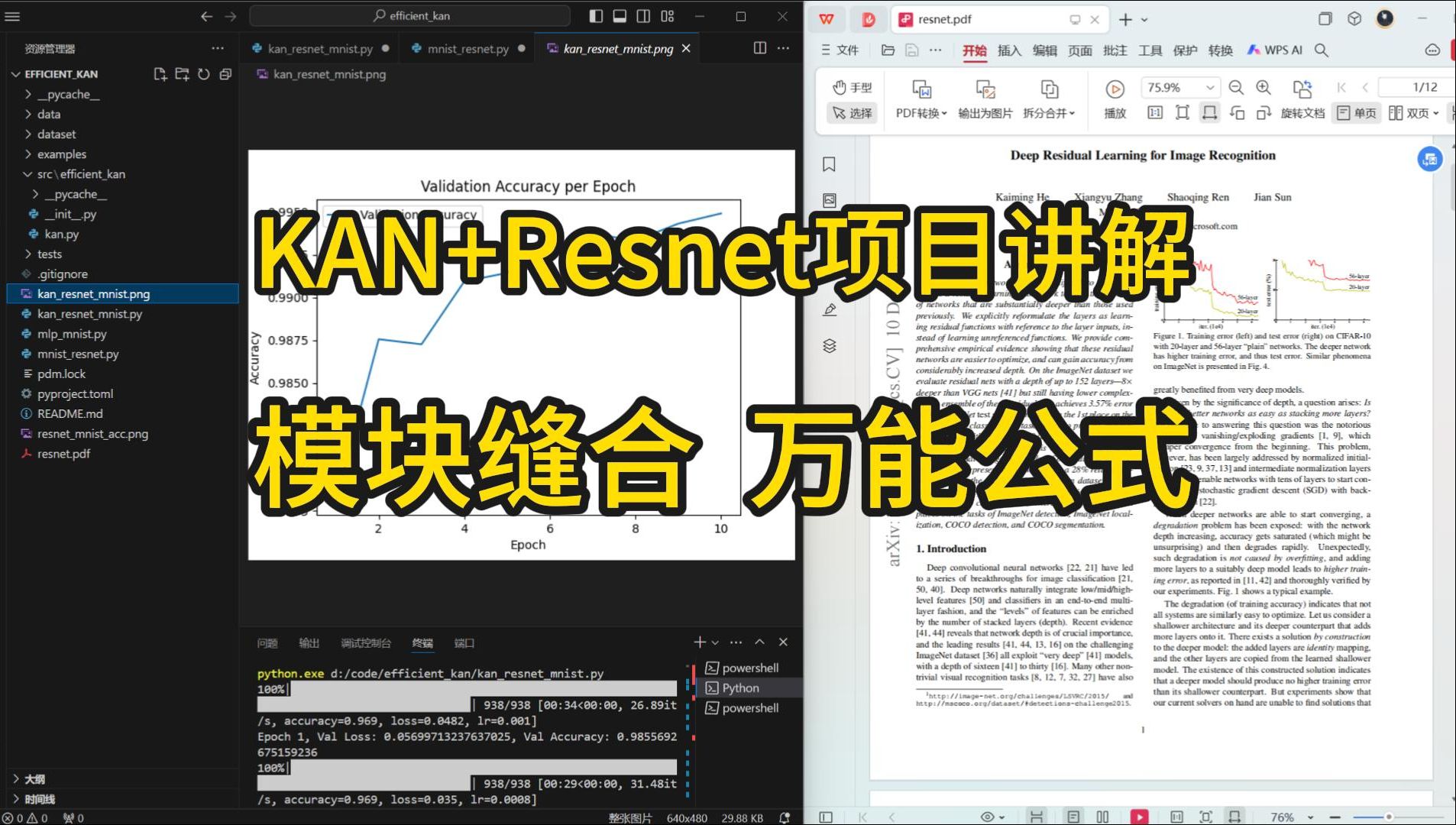

KAN+Resnet项目讲解,融入KAN后指标超越原残差神经网络,学会这个方法融合进任意神经网络

Zeref_:

Zeref_:

0.1%其实可以算误差了,直接替换mlp一两层,在大网络里面意义不大。。我也测了fashionmnist等复杂点的场景,区别越来越小。

【回复】很多参数没有调整,但是效果确实很棒了,我也实验了下cifar10数据以及其他数据 目前来看分类任务效果还不错 刚诞生还需要时间不断优化

【回复】回复 @GUANGGUASFS : 把数据集套下就行,遥感图像也是大差不差的,若通道有问题的话将模型中第一个卷积层的in_c改下

【回复】回复 @AI算法工程师01 :up主,想问一下,这个代码要怎么修改成对RSI-CB128数据集进行学习训练 很细的朴臣:

很细的朴臣:

up,想请问将kan+cnn运用在tabular数据上进行二分类或者多分类问题 该怎么改代码呢

【回复】这种数据的话我们一般使用机器学习传统算法来做,用神经网络的话那需要将数据看作一个二维数组,需要添加维度 GUANGGUASFS:

GUANGGUASFS:

请问这个可以用来进行学习RSI-CB128数据集吗?要跟哪个网络结合呢?

【回复】遥感分类吗,大多都能做,比如resnet、vit等 万物皆可璇:

万物皆可璇:

up这个可以改到图像生成网络中么?求up出一期

【回复】将kan看作mlp的平替更换就行,或者改linear层 梦里的顿河静悄悄:

梦里的顿河静悄悄:

您好up 用了您给的kan替换mlp 效果的确变好了 想请问一下 这个里面的kan就是原文中的kan嘛,看注释上面写的好像改了一些

【回复】是高效实现的kan,在pykan往下翻能看到对应这块 AI算法工程师01:

AI算法工程师01:

各位小伙伴若对项目有疑虑可以提出[doge]

【回复】回复 @我是星用户 : 本身略带正则化的效果,减少模型复杂度,还可以加速模型训练等,BN还是比较常用的

【回复】为什么批量归一化可以防止过拟合?

神经网络 KAN 人工智能 AI 科技 KAN神经网络 最新科技 深度学习 计算机技术 resnet